KI ist in der Fertigungsindustrie kein neues Thema, wie die vielen Anwendungen von Predictive AI zeigen. Allerdings beschränkt sich der Einsatz von KI bisher oft nur auf die Maschinenebene. Der Zustand einer gesamten Produktionslinie oder die Kommunikation zwischen verschiedenen Systemen bleiben dabei häufig außen vor. Mit den Fortschritten der generativen KI wird hier aber ein Wandel einsetzen, der eine effizientere industrielle Fertigung maßgeblich vorantreiben wird. Das Potenzial der generativen KI zeigt sich gerade in der Mensch-Maschine-Interaktion. Dabei geht es nicht darum, den Maschinen-Operator zu ersetzen. Vielmehr soll er bei technischen Herausforderungen durch KI-generierte Hinweise unterstützt werden, um die Produktivität insgesamt zu erhöhen.

LLMs sind nicht alles

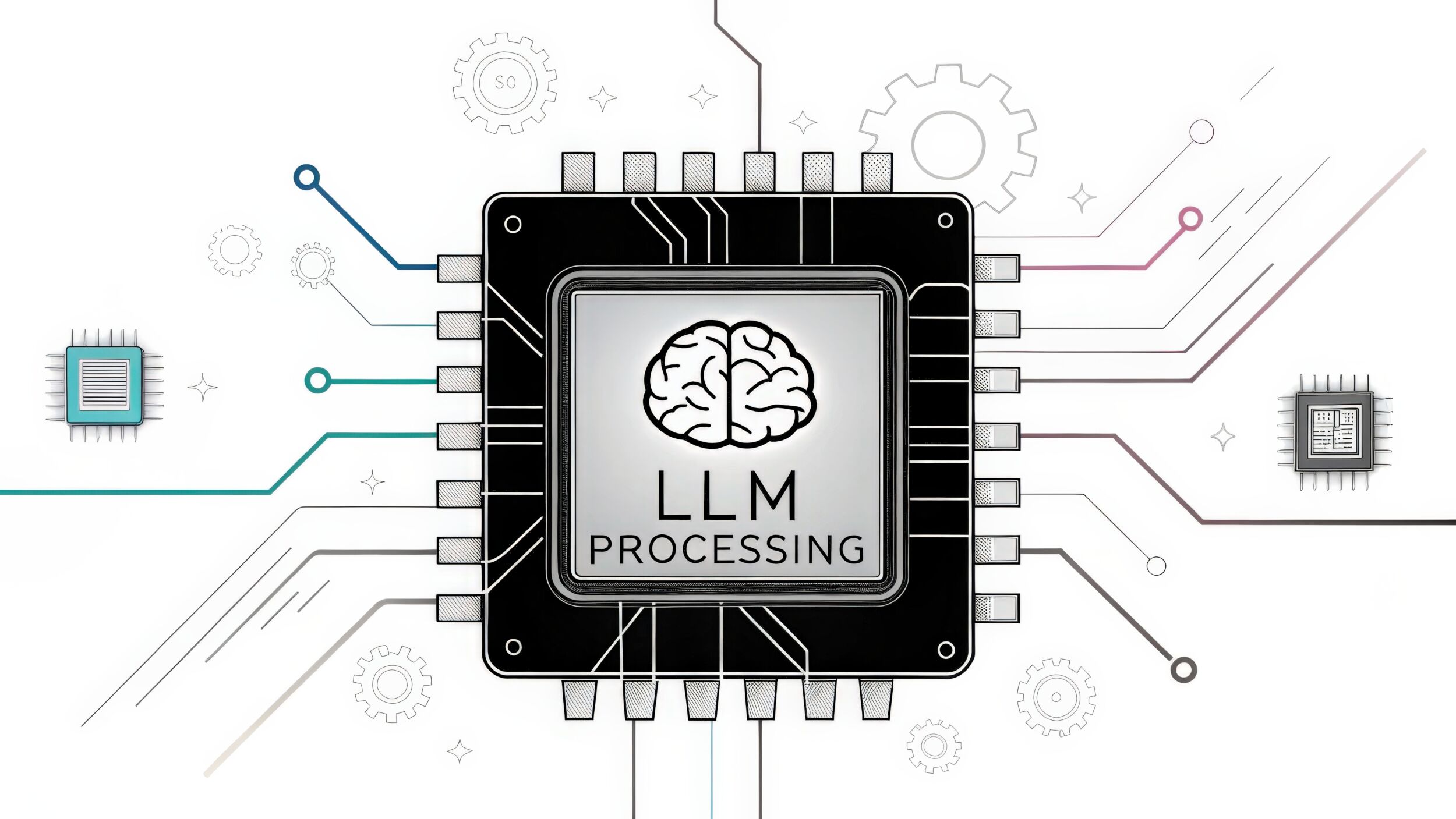

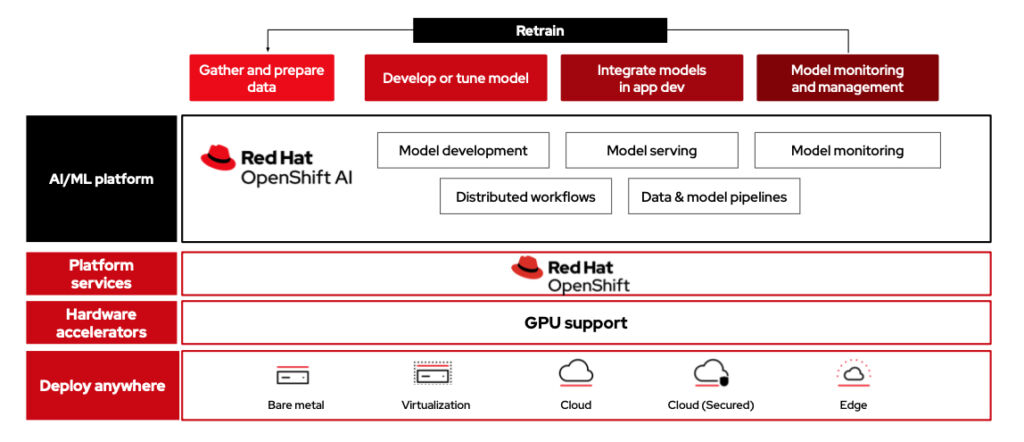

Wichtig bei der KI-Nutzung im Fertigungsbereich ist, nicht ausschließlich auf LLMs (Large Language Models) zu setzen. Diese Modelle sind mit sehr großen Datenmengen trainiert, das heißt, alle Informationen stecken in den Modellen und ihr Wissen ist immer die Basis für die Antworten. In der Regel sind somit keine aktuellen Daten vorhanden. Für die Echtzeitnutzung in der Produktion ist das folglich nicht ausreichend. Es geht also darum, dass nicht nur das LLM als Wissensquelle genutzt wird, sondern auch weitere Dokumente, Online-Web-Suchergebnisse und dann vor allem auch unternehmensspezifische Echtzeit- und Maschinendaten wie z.B. Logdaten oder Fehlermeldungen. Für die Datenspeicherung dienen dabei Vektordatenbanken. Aus den Daten generiert das LLM dann eine Antwort, die dem Maschinen-Operator hilft, Probleme zu lösen. Konkret wird dabei der Prompt des Users, das heißt des Maschinen-Operators, im Hintergrund mit den oben genannten Daten angereichert, sodass das LLM eine möglichst exakte Antwort gibt.

Schneller Forschritt bei Technik

Inzwischen gibt es bereits mehrere Ansätze und Techniken, die die LLMs mit weiteren Informationen anreichern. Bekannte Beispiele dafür sind RAG (Retrieval-Augmented Generation) und Agentic AI. RAG bietet die Möglichkeit, die in einem LLM vorhandenen Daten durch externe Wissensquellen zu ergänzen, etwa durch Daten-Repositories oder bestehende Dokumentation. So kann auch wesentlich einfacher sichergestellt werden, dass die Modelle richtige, sichere Antworten liefern, ohne zu halluzinieren. Mit AI Agents können Probleme unter Nutzung von Daten aus einem LLM, einer Vektordatenbank, einer Knowledge Base oder aus dem Internet analysiert werden, um Schlussfolgerungen zu ziehen und Entscheidungen zu treffen, die dann als Informationen für einen Operator oder die eigenständige Veranlassung von Veränderungen dienen.

Kleine Modelle liegen im Trend

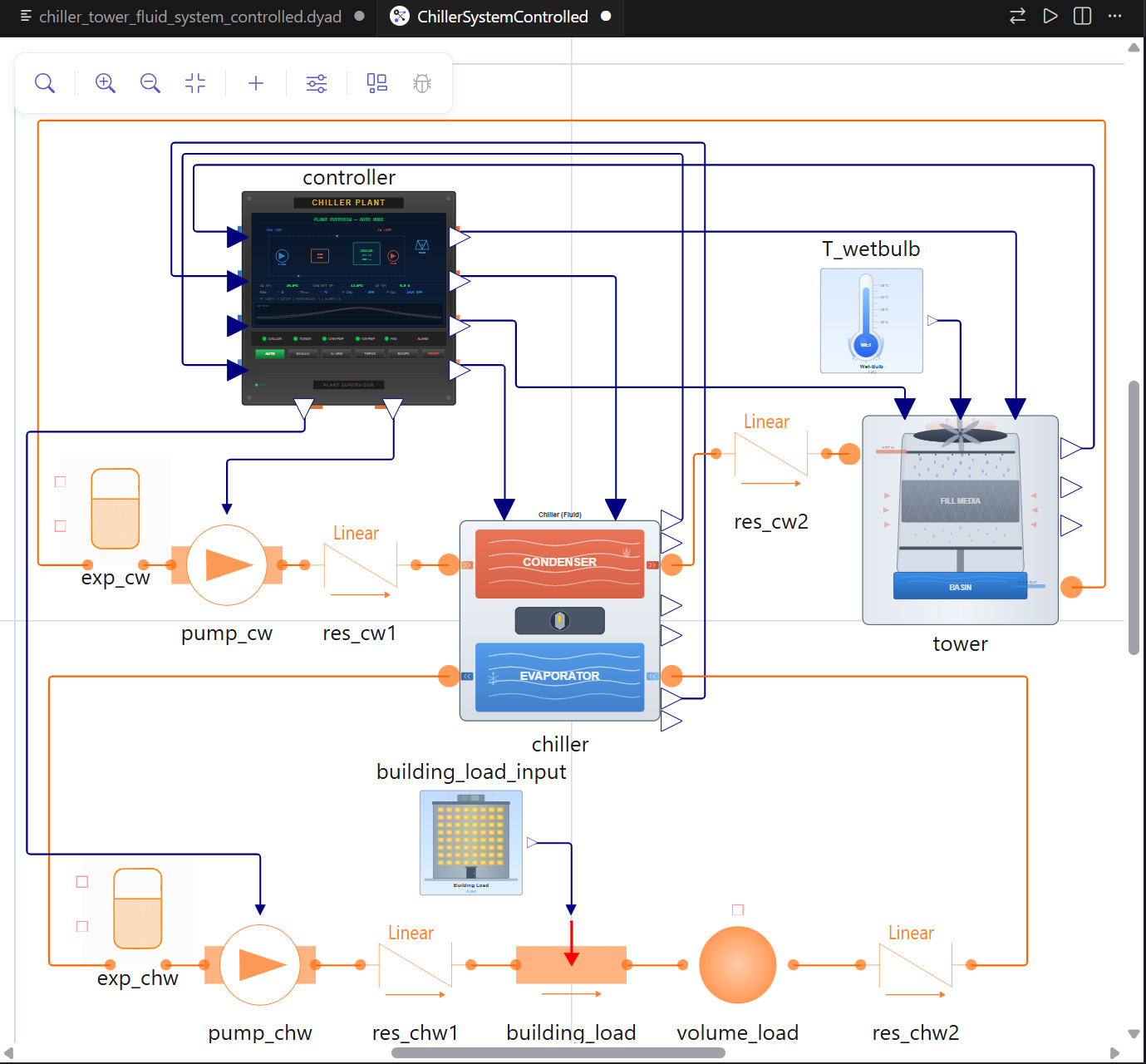

Bei der Auswahl des passenden Modells stehen Fertigungsunternehmen vor einer ersten Herausforderung. Hier zeichnet sich ab, dass immer mehr Firmen nicht auf LLMs, sondern auf kleinere Modelle setzen, die für spezielle Use Cases trainiert werden. Sie sind kosteneffizienter und mit geringerem Aufwand zu realisieren. Doch wie sollten Unternehmen nun eine Implementierung in Angriff nehmen – mit dem Ziel, KI nicht nur auf Maschinenbasis, sondern im Kontext einer gesamten Produktionslinie einzusetzen? Eine zentrale Voraussetzung ist die Verfügbarkeit der Daten. Im Großen und Ganzen sind sie vielfach schon vorhanden, etwa in Datenbanken oder Data Lakes. Eine Datenquelle bieten darüber hinaus die in der Fertigungsindustrie oft genutzten Digital Twins. Ist die Datenverfügbarkeit gegeben, geht es in einem nächsten Schritt um die semantische Verknüpfung der Daten und den Verbindungsaufbau zwischen den Maschinen. Hierfür eignet sich etwa eine Graphdatenbank.