KI-Beschleuniger an der Edge

Mit ihrer Low-Power-Architektur und Skalierbarkeit bietet die Mustang-Serie von ICP eine Alternative zu GPU-basierten KI-Lösungen. Die Kompatibilität zum OpenVino Toolkit bietet zudem eine einfache Möglichkeit Trainingsmodelle an der Edge zu implementieren.

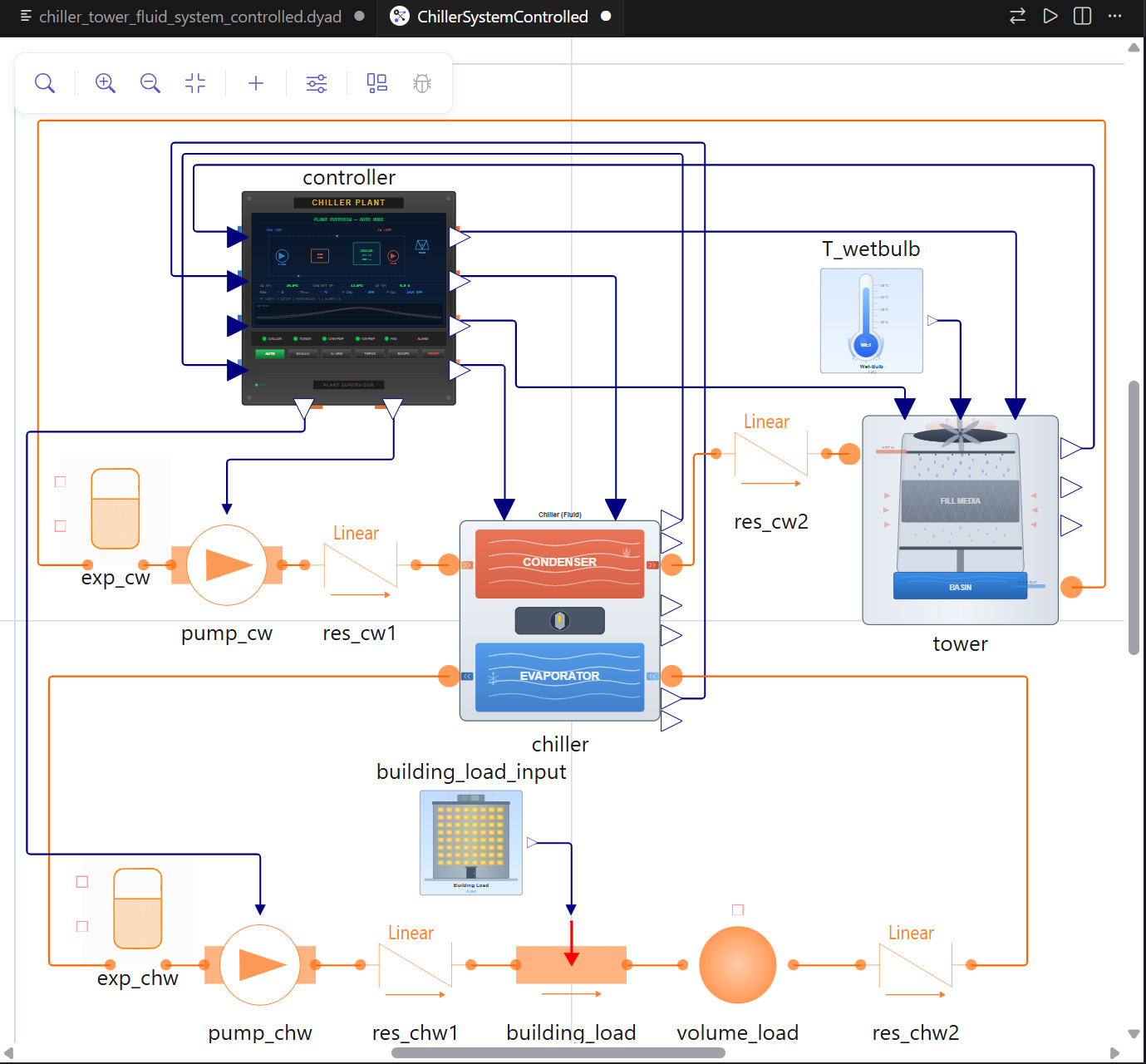

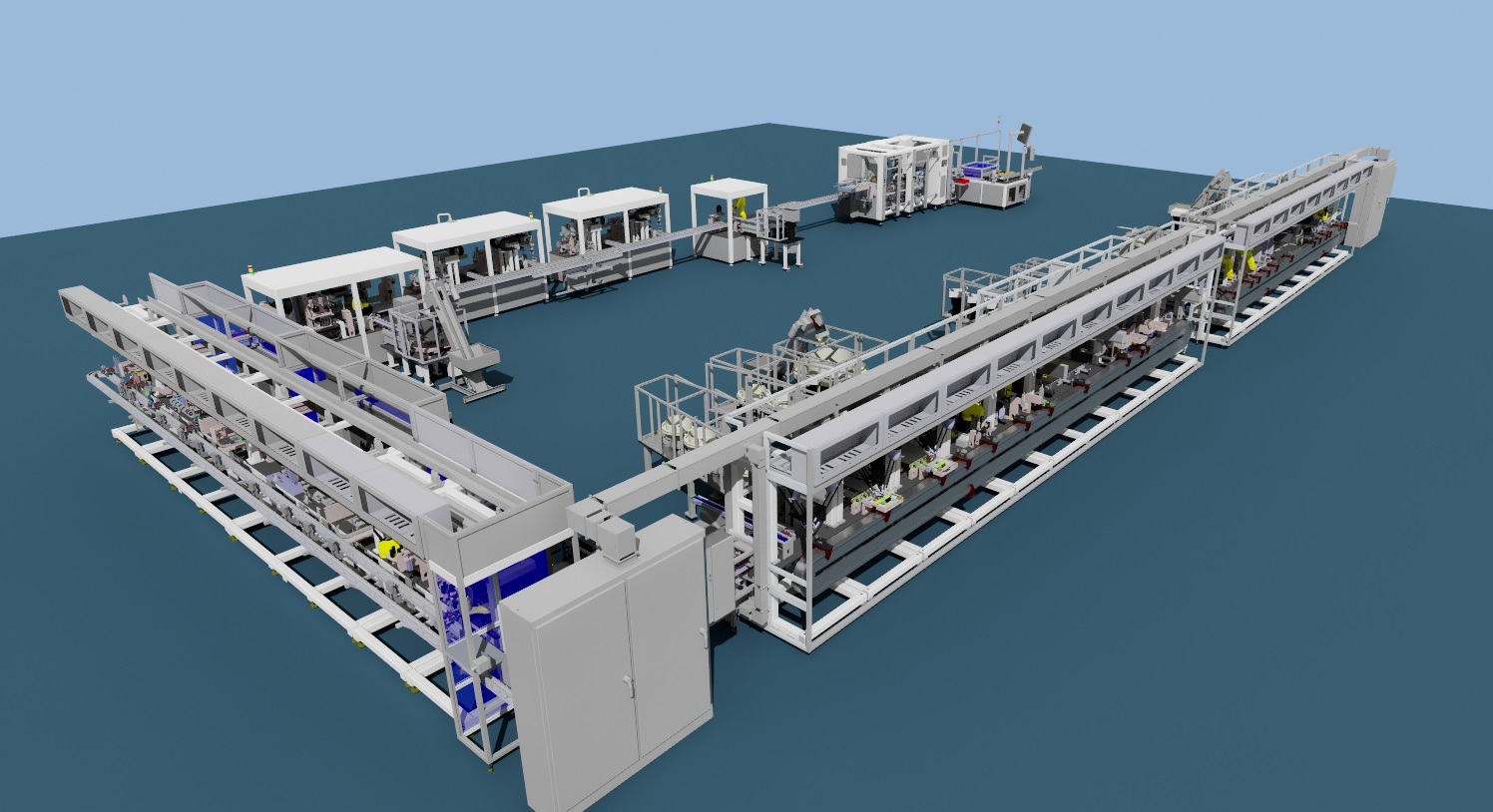

Industrie-PC-Systeme, oder sogenannte Inferenzsysteme kommen zum Einsatz, um anhand von Bildern Entscheidungen über den Zustand von Produktionserzeugnissen zu treffen. Diese Inferenzsysteme verwenden vortrainierte Datensätze, sogenannte Trainingsmodelle, die in Hochleistungsrechnern erstellt worden sind. Kommen bei diesen Trainingsservern meist mehrere Grafikkarten zum Einsatz, um das Modell möglichst schnell zu klassifizieren, ist der Einsatz von Grafikkarten an Edge aus unterschiedlichen Gründen nicht sinnvoll oder möglich. Hier spielen Anforderungen wie die physische Größe des Inferenzsystems, der Stromverbrauch und das Preis- Leistungsverhältnis eine Rolle. Diese Anforderungen lassen sich mit GPU-basierten Systemen nicht erfüllen. Mit der Mustang-Serie der KI-Beschleunigerkarten bieten sich allerdings Möglichkeiten für das Edge Computing bzw. das Artificial Intelligence of Things (AIoT). Es stehen zwei unterschiedliche Serien zur Auswahl um flexibel und skalierbar KI-Anwendungen an der Edge zu realisieren.

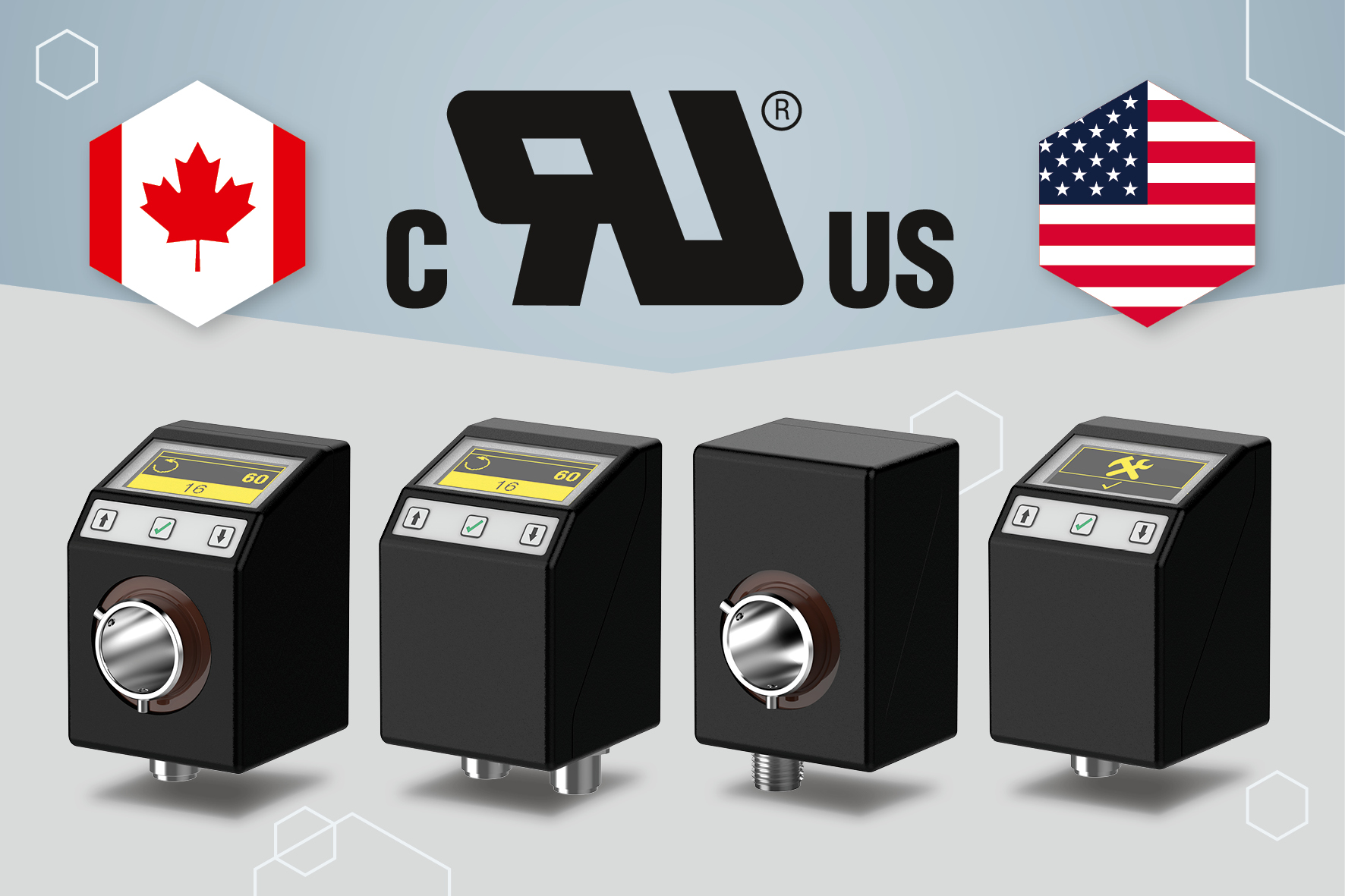

VPU Beschleunigerkarten

Die VPU-basierte Mustang-Serie verwendet Intel Movidius Myriad X MA2485 Visual Processing Units. Diese VPUs sind durch die Kombination ihres neuralen Netzwerks mit 16 Shave-Kernen und ihrer Neural Compute Engine speziell für KI-Anwendungen im Vision-Bereich ausgelegt. Neben einer Vielzahl von implementierten Hardwarefunktionen für die Bildverarbeitung, enthält jede VPU eine neue Stereo-Depth-Block-Funktion, die in der Lage ist zwei Streams mit einer Auflösung von 720P bei 180Hz zu verarbeiten. Native FP16 Berechnungen oder 8Bit Festkommaberechnungen aber auch die abstimmbare ISP-Pipeline und die hardwarebasierte Codierung lassen auch anspruchsvolle Bild-oder Videoverarbeitung mit einer Auflösung von bis zu 4K zu. Jeder einzelnen VPU lässt sich dabei eine andere DL-Topologie zuweisen. Grund hierfür ist die Multi-Channel Fähigkeit der VPUs, die eine simultane Ausführung von Berechnungen ermöglicht. So lassen sich unterschiedliche Anwendungen wie Objekterkennung oder Bild- und Videoklassifikation gleichzeitig ausführen. Auf der PCI Express x4 Bus-basierten Mustang-V100-MX8 kommen gleich acht dieser VPUs zum Einsatz und erreichen eine Rechenleistung von einem TOPS. Damit ist die Mustang-V100-MX8 in der Lage mehr als zehn Video Streams gleichzeitig zu verarbeiten. Der Stromverbrauch hält sich dabei in Grenzen. Jede VPU verbraucht nur 2.5W. Im Gesamten verbleibt die Mustang-V100-MX8 unter 30W und eignet sich für anspruchsvolle Low-Power KI-Anwendungen. Sind weniger als zehn Streams zu verarbeiten kann eine kleinere Variante, wie die Mustang-V100-MX4 mit vier MA2485 VPU Einheiten, verwendet werden. Die Mustang-V100-MX4 basiert ebenfalls auf dem PCI Express Bus benötigt allerdings nur einen x2 Steckplatz und kann in nahezu jeden Kompakt PC verbaut werden. Für besonders kompakte Embedded PC Systeme die keinen PCI Express Steckplatz bieten, stehen zwei VPU Module zur Auswahl die auf dem M.2 Formfaktor basieren. Die Mustang-M2AE-MX1 mit einer VPU Einheit sowie die Mustang-M2BM-MX2 mit zwei MA2485 VPU Einheiten. Für Systeme mit älterem Mini-PCI Express Bus eignet sich die Mustang-MPCIE-MX2 mit zwei Myriad VPU Einheiten.